Knack Focus blikt terug en biedt de beste verhalen van 2018 opnieuw aan.

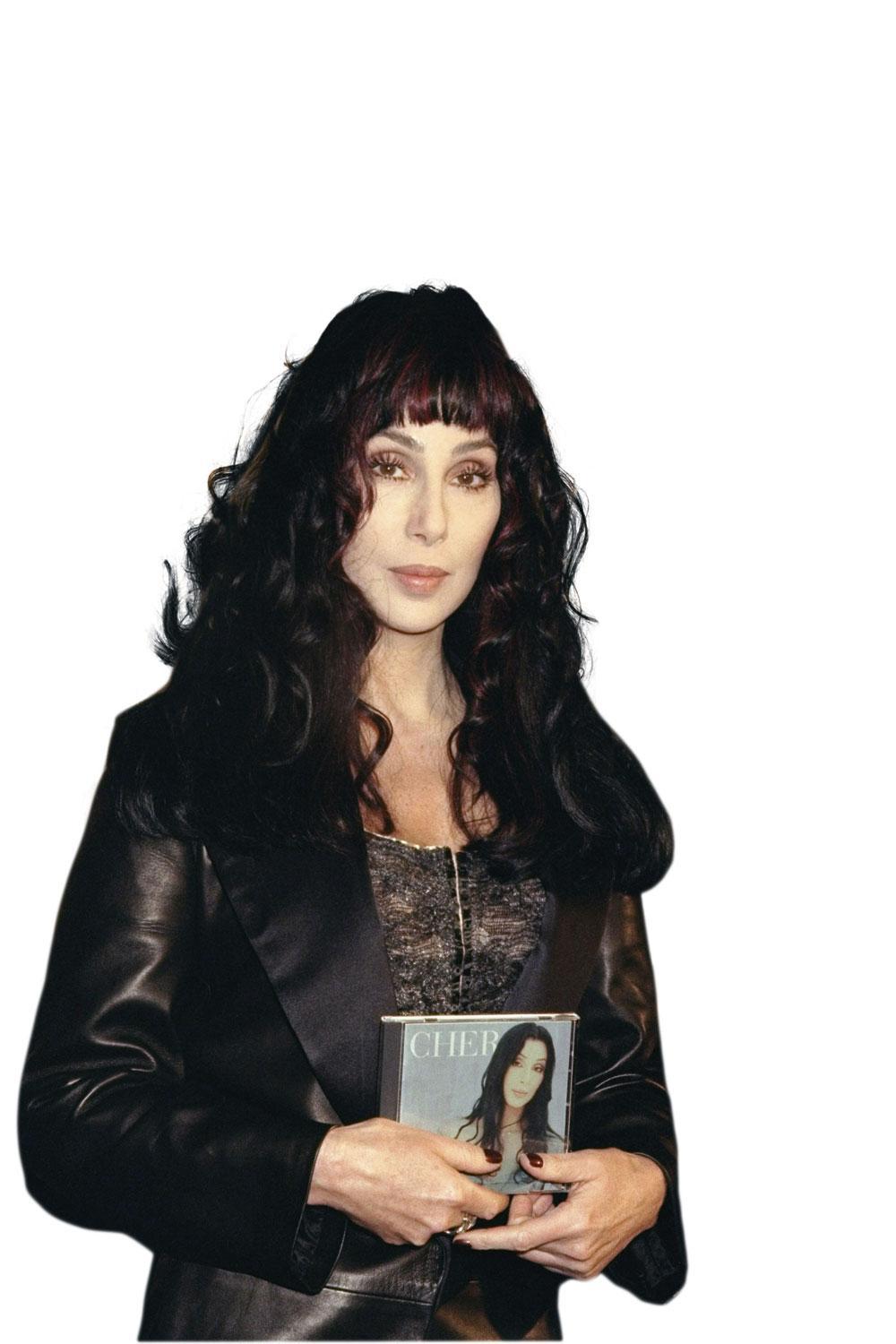

Deze maand is het precies twintig jaar geleden dat Cher Believe uitbracht en de wereld voor de eerste keer met Auto-Tune kennismaakte. Het zou het begin blijken van een bijzonder verhaal over olietechnologie, speelgoedmicrofoons, cyborgs en liefdesverdriet. Een verhaal dat het geluid van de vroege eenentwintigste eeuw heeft bepaald.

Lees hier de rest van de beste Knack Focus-verhalen uit 2018.

Het is in het tweede couplet dat je het voor de eerste keer duidelijk hoort. ‘And I can’t break through/ There’s no talking to you’, zingt Cher over een eurobeat. Wanneer ze ‘can’t’ zingt, lijkt haar stem even te bevriezen. Het is bijna een glitch, als een androïde in een eightiessciencefictionfilm die even hapert en haar stiekeme robotgelaat openbaart – in de videoclip zie je het beeld ook even verspringen. Alleen: het is geen hapering. Wanneer ze even later ‘It’s so sad that you’re leaving/ It takes time to believe it’ zingt, hoor je het opnieuw in ‘sad’ en ’time’, haar stem die heel even in bits en bytes verandert en dan weer menselijk wordt.

‘Over mijn lijk’, zei Cher toen de platenbazen eisten dat ze dat rare effect van haar stem haalde. Believe werd de 23e meest verkochte single aller tijden.

Deze maand is het precies twintig jaar geleden dat Cher Believe uitbracht. Ze was 52 toen, maar ze zag er hoogstens 26 uit. Toen ze in 1998 haar comeback maakte, was het vooral dat optische leeftijdsverschil dat de aandacht trok. Misschien daarom dat de meeste mensen het misten: de software achter haar robotstem zou de grootste technologische ontwikkeling van de twee daaropvolgende decennia worden. Het zou de muziekwereld in twee verdelen. Het zou de carrière van Kanye West en Bon Iver in een nieuwe richting duwen. Het zou de toekomst van de hiphop en de pop bepalen. Het zou voor minstens één T-Pain zorgen.

Wat je hoorde toen Cher die eerste keer ‘can’t’ zong, was geen computereffectje.

Het was het geluid van de eenentwintigste eeuw dat eraan kwam.

1998: De producer van Cher morrelt aan de settings van Auto-Tune.

Bijna was Chers robotstem er nooit geweest. In augustus van 1998 zat Mark Taylor, een van Chers producers, nog maar eens te sleutelen aan Believe. Iedereen was blij met het refrein, maar er schortte iets aan de strofes. Cher had geopperd om met vocoders te experimenteren – in de lijn van Andrew Roachford, een Britse singer-songwriter van wie ze fan was. Net op dat moment arriveerde een nieuwe plug-in in de studio: Auto-Tune.

Auto-Tune, ontwikkeld door Antares Audio Technology, was in 1998 al een jaar op de markt, maar had onder producers de status van een industrieel geheim. In wezen is het namelijk geen roboteffect, maar een briljant stukje pitch-correction-software: als een zanger of zangeres in de studio een valse noot zong, dan trok Auto-Tune die fout automatisch recht. Als een soort muzikale tintenkiller, zo u wilt. Daarom werd er ook zo geheimzinnig over Auto-Tune gedaan: geen enkele zanger of zangeres wilde geassocieerd worden met een machine die ervoor zorgt dat je niet vals zingt. Veel artiesten wisten – en weten – zelfs niet dat hun producers Auto-Tune gebruiken en geloofden hen blindelings als ze zeiden dat ‘de take helemaal perfect was’.

Auto-Tune had een knopje met het label ‘Retune Speed’. Dat was de snelheid waarmee een valse noot gecorrigeerd werd op een schaal van 1 tot 9. ‘9’ was een heel trage en geleidelijke correctie, vooral bedoeld voor lange noten in pakweg ballads. ‘1’ was heel snel en bruusk, ideaal voor korte noten in uptempotracks. Maar Auto-Tune had ook een ‘0’-setting. ‘0’ wilde zeggen dat de algoritmes van Auto-Tune elke noot meteen en radicaal rechttrokken. Op zich was dat een onbruikbare stand voor producers. De menselijke stem, ook die van de meest toonvaste zangers, bestaat uit kleine variaties, buigingen en vibrato’s. Auto-Tune op zero-stand laat dat soort stemkleur niet toe en maakt er aparte noten van. Waardoor je een onnatuurlijk roboteffect krijgt.

Dat was ook wat Mark Taylor ontdekte terwijl hij de software aan het testen was. Toen hij de Retune Speed op nul zette, klonk Cher plots als een robot. Het leek op de vocoder waar Cher naar gevraagd had (een soort stemsynthesizer uit de jaren zeventig, gebaseerd op volledig andere technologie), maar het was subtieler. Menselijker. Simpel gezegd: was de vocoder een robot, dan was Auto-Tune een androïde.

Taylor maakte een mix waarin hij Auto-Tune op de strofes zette, maar twijfelde of hij het aan Cher zou laten horen. ‘Pas na een paar biertjes besloten we het toch te doen’, zei Taylor daarover in The New York Times. ‘Cher ging uit haar dak. Op een goede manier.’ Meer zelfs: ze vócht voor het effect. Toen de platenbazen bij Warner Bros. Records Believe hoorden, eisten ze dat het effect er weer afgehaald zou worden. ‘Over mijn lijk’, antwoordde Cher. Twee maanden later stond Believe in drieëntwintig landen op nummer één, werd de 23e meest verkochte single aller tijden en was het ‘Cher Effect’, zoals Auto-Tune zeven jaar lang genoemd zou worden, geboren.

Fijn detail: de producers van Believe probeerden aanvankelijk geheim te houden dat het Cher Effect een extreme setting van Auto-Tune was en logen in vakbladen dat ze de DigiTech Talker FX hadden gebruikt, een vocoder die toen net op de markt was. Deels om Cher niet in verband te brengen met software voor niet zo toonvaste zangeressen. Deels omdat ze het als hun eigen productiegeheimpje beschouwden. Tevergeefs.

Nog voor de eeuwwisseling wist elke producer van de ‘0’-knop.

1995: Een steenrijke seismologisch ingenieur is op zoek naar een hobbyproject.

Nog merkwaardiger dan het verhaal achter Chers robotstem is de ontstaansgeschiedenis van Auto-Tune zelf. De technologie daarachter was namelijk nooit bedoeld om valse noten recht te trekken. Ze was ontwikkeld om naar olievoorraden te speuren.

De technologie achter Auto-Tune was nooit bedoeld om valse noten recht te trekken. Ze was ontwikkeld om naar olie te speuren.

Eind jaren zeventig was Andy Hildebrand een elektrotechnisch ingenieur bij het Amerikaanse oliebedrijf Exxon. Zijn job was het analyseren van seismische data om zo naar de optimale locatie voor olieboringen te speuren. De technologie die hij daartoe gebruikte, was vergelijkbaar met sonar. ‘We stuurden geluiden de grond in, namen de echo’s op die terugkwamen en probeerden zo te kijken welke aardlagen er onder de grond zaten’, legde hij het zelf uit op Priceonomics.com. ‘Heel complexe materie. Het is alsof je op basis van het geluid van de donder probeert te achterhalen hoe de bliksem eruitziet.’

Hildebrand werd een expert in geluidsanalyse – en vooral in het bedenken van de wiskundige algoritmes die de geluidsgolven interpreteerden. Hij zou er zijn fortuin op bouwen. In de jaren tachtig richtte hij zijn eigen bedrijf op, dat in 1995, toen Hildebrand al even op pensioen was, door Halliburton werd gekocht voor een half miljard dollar. Waarna de ingenieur niet alleen veel vrije tijd, maar ook geld ter beschikking had.

Tijd en geld die hij in de muziekwereld wilde steken. Hildebrand was in zijn jeugd een virtuoos dwarsfluitspeler geweest. Niet het hipste instrument aller tijden, maar toch. Op zijn zestiende had hij als studiomuzikant gewerkt en zijn ingenieursstudies had hij met een muziekbeurs gefinancierd. Toen hij in 1990 Antares Audio Technology oprichtte, was dat dan ook om iets in de muziek te kunnen betekenen. Alleen miste hij een concreet project. Dat kwam er vijf jaar later, toen hij tijdens een etentje met enkele vrienden terloops vroeg op welke uitvinding ze zaten te wachten. ‘Een machine die ervoor zorgt dat ik niet vals zing’, zei een van de vrouwen lachend. Zes maanden later spookte die opmerking nog altijd door zijn hoofd.

Pitch-correction-software was zowat de heilige graal onder geluidsingenieurs. Velen hadden zich eraan gewaagd, niemand was erin geslaagd. Iedereen botste op hetzelfde probleem: geen enkele computer was in staat om de benodigde hoeveelheid data te analyseren – en al helemaal niet in real time. Maar Hildebrand had een andere achtergrond dan de gemiddelde geluidsingenieur. Hij realiseerde zich dat de analyse van een stem niet zo verschillend is van de analyse van geologische data. En dus dat de algoritmes die hij uit de olie-industrie kende ook bruikbaar waren in de muziekwereld. Wat volgde, was een briljant stukje wiskunde waarvan we u de gedetailleerde uitleg besparen – het heeft te maken met begrippen als ‘deconvulatie’, ‘forward modeling’ en ‘autocorrelatie’. ‘Ik ben nog niemand tegengekomen aan wie ik het heb kunnen uitleggen. Meestal zeg ik gewoon dat het magie is’, aldus Hildebrand. In elk geval: hij slaagde erin de berekeningen zo simpel te houden dat een computer ze kon verwerken. Datzelfde jaar schreef hij in enkele maanden tijd de software voor Auto-Tune op een Macintosh. Met daarop dus een knop om de Retune Speed te bepalen. ‘Voor de grap had ik er ook een onbruikbare zero-stand aan toegevoegd’, aldus Hildebrand.

‘It was just for kicks.’

2004: Het enige waar het T-Pain aan ontbreekt, is een gimmick.

In 2004 zat Faheem Rashad Najm, een aanstormende rapper met een voorliefde voor hoge hoeden en skibrillen en het diepe verlangen om ooit op een boot terecht te komen, tv te kijken. T-Pain, zoals Najm zichzelf noemde, had net getekend bij het label van Akon, maar zocht nog naar een gimmick die hem onderscheidde van alle andere aanstormende rappers. Op tv passeerde een remix van Jennifer Lopez‘ If You Had My Love door Darkchild, die J-Lo’s stem door Auto-Tune had gejaagd. ‘Ik moet dat effect hebben’, zei T-Pain.

Aldus werd de samenwerking tussen T-Pain en Auto-Tune geboren. Een samenwerking die ervoor zou zorgen dat hij in vijf jaar tijd drie platina platen vergaarde, tot de favoriete gastzanger van Kanye West, Lil Wayne, Flo Rida, Chris Brown en de hiphopwereld uitgroeide en meewerkte aan ruim vijftig hits. In 2007 stond hij één week lang met vier nummers tegelijk in Billboards top tien.

Dat alles terwijl hij een paarse top hat droeg.

Dat doet ertoe.

T-Pain optimaliseerde zijn stem niet om zo goed mogelijk te zingen. Hij optimaliseerde zijn stem om zo goed mogelijk te klinken in Auto-Tune.

Na 2005 veranderde het Cher Effect van naam en werd het het T-Pain Effect. De rapper gebruikte het roboteffect zo vaak en zo nadrukkelijk dat hij er synoniem mee werd. Iets wat duidelijk ook zijn bedoeling was. T-Pain – bij ons is hij vreemd genoeg vooral bekend van de parodie I’m on a Boat – was een van de eerste artiesten die zich niet schaamden voor Auto-Tune, maar het net omarmden.

Sinds Chers Believe was de populariteit van Auto-Tune gestaag gestegen. Radiohead experimenteerde in 2001 al met de technologie op Amnesiac. Daft Punk had het als roboteffect gebruikt in de vocalen van Around the World. De voltallige muziekwereld gebruikte Auto-Tune om valse noten te corrigeren, maar deed dat vooral subtiel en in alle stilte. T-Pain – die overigens zonder Auto-Tune een uitstekende stem had, getuige YouTube – deed het omgekeerde en maakte er zijn merk van. In 2009 werkte hij samen met Antares om een app uit te brengen, I Am T-Pain, die je stem vervormde via Auto-Tune. Vervolgens ging hij een stap verder en bracht hij zijn eigen pitch-correction-software uit. Hoogtepunt was een speelgoedmicrofoon met ingebouwde speaker die behalve je stem autotunen ook de zin ‘Hey, this ya boy T-Pain!’ kon roepen.

Die speelgoedmicro klinkt belachelijk, maar was wel degelijk van belang. T-Pain deed namelijk iets nieuws met Auto-Tune. Tot dan werd het nagenoeg uitsluitend gebruikt in postproductie. De artiest zong in de studio een cleane versie, de producer zette er achteraf roboteffecten op. T-Pain deed het anders: hij maakte geen opname zonder effecten, hij zong rechtstreeks met Auto-Tune.Dat doet ertoe omdat het het karakter van Auto-Tune veranderde. De stem ging interageren met de software. Vals zingen of rare vibrato’s konden, rechtgetrokken door Auto-Tune, volkomen anders klinken. T-Pain optimaliseerde zijn stem niet om zo goed mogelijk te zingen. Hij optimaliseerde zijn stem om zo goed mogelijk te klinken in Auto-Tune. T-Pain propageerde dat idee ook: toen Kanye West en Future met Auto-Tune begonnen – door het in postproductie gebruikten – was het T-Pain die hen erop wees dat ze verkeerd bezig waren. Het enige juiste gebruik van Auto-Tune was live-interactie. Vandaag hebben veel rappers zelfs hun persoonlijke Auto-Tune-ingenieurs in de studio om de machine te bedienen.

Eigenlijk was de titel van Kanye Wests 808s & Heartbreak fout: veel meer dan de iconische 808-sampler was het Auto-Tune dat gestalte gaf aan zijn rauwe emoties.

Dat is waar Auto-Tune impact begint te hebben op de essentie van muziek. Zodra T-Pain rechtstreeks via Auto-Tune zong, werd hij in wezen een soort cyborg. De menselijke stem en de technologie vloeiden in elkaar over. Het was de volgende stap in de lange traditie van computers en stemmen – van de eerste IBM-computer die Daisy Bell zong tot Neil Youngs experimenten met een vocoder. De rappers na T-Pain – van Chief Keef over Future tot Migos – zouden die cyborgkant van Auto-Tune nog meer onderzoeken.

Laat u niet misleiden door de hoge hoed.

T-Pain was een genie.

2008: Kanye West verwerkt zijn moeilijke jaar op 808s & Heartbreak.

T-Pain deed nog iets anders. Net doordat hij vijf jaar lang bij uitstek de gastzanger op andermans platen was, introduceerde hij Auto-Tune bij zowat iedereen in de hiphopwereld. Twee van de mensen met wie hij gewerkt heeft, zouden voor Auto-Tune de volgende stap betekenen.

De eerste was Lil Wayne, die in het voorjaar van 2008 Tha Carter III uitbracht, een plaat waarop hij voor het eerst met Auto-Tune experimenteerde. Maar Lil Wayne deed meer dan op de trend springen. Hij gebruikte Auto-Tune niet om als een robot te klinken. Lil Wayne, op dat moment zwaar verslaafd aan codeïne, gebruikte het als een psychedelisch effect. Wat de flangerpedaal was voor de psychedelica van de jaren zestig, was Auto-Tune voor Lil Wayne. Lollipop, de eerste single van die plaat, zou zijn eerste en enige nummer-eenhit worden in de States.

Maar het was een andere rapper met wie T-Pain gewerkt had die nog meer zijn stempel op Auto-Tune zou drukken: Kanye West. 2007 was geen goed jaar geweest voor West. Zijn moeder, Donda West, was overleden door complicaties na een cosmetische ingreep. Enkele maanden later raakte het uit met zijn verloofde Alexis Phifer. Voor het eerst sinds hij was beginnen rappen, voelde hij zich reddeloos verloren. En het geluid van die reddeloosheid was Auto-Tune.

808s & Heartbreak verscheen eind 2008 en liet Kanye West horen zoals niemand hem kende. Hij gebruikte nauwelijks samples, refereerde aan geen enkel luxemerk en deed het met spaarzame elektronica en Auto-Tune. ‘Auto-Tune meets distortion, with a bit of delay on it and a whole bunch of fucked-up life’, zo omschreef hij zelf zijn nieuwe geluid. Eigenlijk had de plaat ‘Auto-Tunes & Heartbreak’ moeten heten: veel meer dan de 808 – een drumcomputer van Roland – was het Auto-Tune dat gestalte gaf aan de rauwe emoties van Kanye West. De jongste jaren is er veel geschreven over hoe Kanye die machine gebruikte om zijn innerlijke leegte als mens uit te drukken. ‘Kanye’s digitale vocalen zijn het geluid van een man die zo verdoofd is door verdriet dat hij geen mens meer is’, schreef Rolling Stone.

Lil Wayne en Kanye West zouden hun impact niet missen. Na Lollipop en 808s & Heartbreak was Auto-Tune geen robotgimmick meer. Het werd het geluid van de 21e-eeuwse onverschilligheid, eenzaamheid, tristesse en reddeloosheid. Auto-Tune zou de ziel uit de muziek halen, zeiden tegenstanders. Het ironische is dat dat zielloze net is wat een generatie jonge artiesten er zo in aantrok.

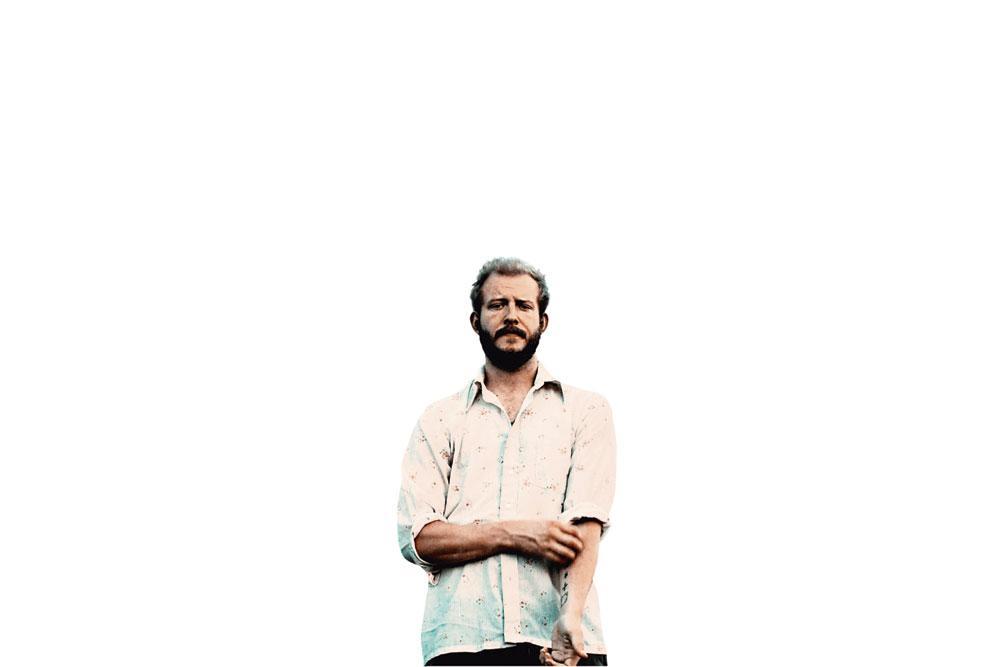

2009: Bon Iver knutselt in de bossen met Auto-Tune.

Een kleine nuance: het meeste wat hier tot dusver beschreven is, is achterafkennis. De waarheid is dat Auto-Tune in dat eerste decennium op heel weinig krediet kon rekenen. Believe was een popniemendalletje van een has-been, T-Pain was een onnozelaar met een hoed op en niemand wist wat ze van Kanye’s 808s & Heartbreak moesten denken – de plaat kreeg een middelmatige 7.6 op Pitchfork. De geschiedenis van de Auto-Tune zoals die vandaag verteld wordt, is er een van omkijken en herinterpreteren.

Doorheen het eerste decennium van de jaren 2000 was Auto-Tune vooral het symbool van de verloedering van de muziek. Zoals gezegd: de oorspronkelijke functie ervan was valse noten rechttrekken. Het leek een trucje voor zangers die niet goed genoeg konden zingen. (Dat imago heeft Auto-Tune nog steeds niet kunnen afschudden.) Toen Cher Believe zong, leek Auto-Tune een cosmetische ingreep van een zangeres die niet vies was van enige plastische chirurgie – ze zag eruit zoals Auto-Tune klonk. Toen T-Pain het in de hiphop introduceerde, leek het een gimmick van een man met een hoge hoed die niet echt kon zingen. Dat was hoe naar Auto-Tune gekeken werd: als het toonbeeld van hoe muziek minder om artisticiteit en talent draaide en meer om commercie en nep. Auto-Tune was geen echte muziek. Het was plastic, ontdaan van alle imperfecties die muziek muziek maken.

Aan het einde van de noughties begon dat idee de muziekwereld in twee kampen te verdelen. ‘Kamp Nee’ leek het daarbij makkelijk te zullen halen. In 2009 verscheen Christina Aguilera in het openbaar in een T-shirt met als boodschap ‘Auto-Tune is for pussies’. Datzelfde jaar bracht Jay-Z D.O.A. (Death of Auto-Tune) uit, een statementsingle waarin hij rapte dat Auto-Tune van de recessie in de muziekwereld een Grote Depressie aan het maken was.

Klinkt vlotter in het Engels.

Maar de meeste tegenwind kwam er uit indiehoek, waar men dweepte met imperfecties en authenticiteit. Niet toevallig de hoek waar ook de muziekpers zich op dat moment toe rekende. Steve Albini, producer van onder meer Nirvana en Pixies, zei in interviews dat hij het deprimerend vond om te zien ‘hoe een productiegimmick slechte zangers laat verbergen dat ze slechte zangers zijn’. Death Cab for Cutie ging uit protest naar de Grammy’s met een blauw lintje, een verwijzing naar het feit dat Auto-Tune ook ‘blue notes’ – bewust valse noten die vooral in de jazz gebruikt werden – als een zielloze machine corrigeerde. (Een euvel dat Antares een paar maanden later bij wijze van mathematische fuck you rechttrok, maar dat terzijde.) Toen Time Auto-Tune op plaats vijftien opnam in zijn lijst van vijftig slechtste uitvindingen, was er niemand om de verdediging op zich te nemen. ‘Het is technologie om slechte zangers goed te doen klinken en heel slechte zangers, zoals T-Pain, als robots. Plus: het geeft zangers die klinken als Kanye West en Cher het misplaatste zelfvertrouwen om te denken dat ze kunnen croonen. Welbedankt, computers’, schreef het weekblad.

Woods van Bon Iver was een meesterwerk, maar ook het bewijs dat de geruchten over de dood van Auto-Tune behoorlijk overdreven waren.

Misschien daarom dat het zo’n impact had dat net Bon Iver in 2009 overstag ging: de lichtende toekomst van de indiewereld, de man die zijn platen in de bossen opnam, van wie niemand zou durven te beweren dat hij niet kon zingen, de artiest die nog wist wat een gitaar was. Twee jaar na For Emma bracht hij een ep uit waarop Woods stond, een grotendeels a-capellanummer. Bijna vijf minuten lang herhaalt hij dezelfde vier zinnen, loopt hij zijn zang en harmoniseert hij zeven keer zijn eigen stem – en dat alles met heel veel Auto-Tune. Woods was een meesterwerk, een harmonie van falsetto en Auto-Tune. Maar het was ook een statement, het bewijs dat de geruchten over de dood van Auto-Tune behoorlijk overdreven waren.

Samen met James Blake zou Bon Iver de volgende push aan Auto-Tune geven. Als zelfs de stemmen die geen enkele vocale assistentie nodig hadden Auto-Tune gebruikten, was het voor iedereen een optie. Een jaar na Woods begonnen Vampire Weekend en Sufjan Stevens ermee te experimenteren. Ze toonden wat T-Pain ook al wilde laten zien: dat Auto-Tune een kunstvorm is. En voor het eerst moesten de haters dat ook beginnen toe te geven.

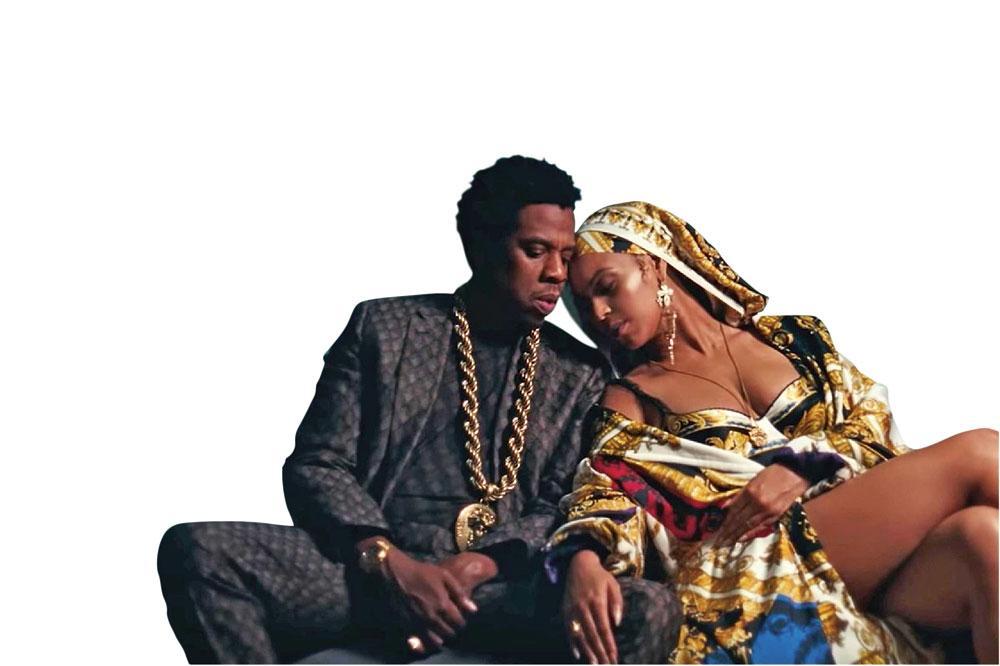

2018: The Carters brengen Apeshit uit.

De Britse muziekjournalist Simon Reynolds noemt het in zijn Pitchfork-artikel How Auto-Tune Revolutionized the Sound of Popular Music dé triomf van Auto-Tune: Beyoncé en Jay-Z’s Apeshit. Twee van de grootste sterren ter wereld die niet anders kunnen dan zich aanpassen aan het dominante geluid van vandaag. Apeshit is een trapsong – een subgenre van de hiphop dat de laatste jaren ontploft is – maar vooral: er wordt Auto-Tune in gebruikt. Beyoncé was twee decennia lang het schoolvoorbeeld van een stem die geen Auto-Tune verdroeg. Jay-Z had in 2009 nog een moment van stilte gevraagd voor het overlijden van Auto-Tune in D.O.A. (Death of Auto-Tune).

Vrij zeker dat hij daar ondertussen spijt van heeft.

2018 was een opmerkelijk jaar voor Auto-Tune – en niet alleen omdat Believe twintig jaar oud is. Het originele patent van Hildebrand is vervallen. Sowieso was de technologie al gedateerd sinds Melodyne op de markt is gekomen, een soort next-level Auto-Tune waarmee je ook pakweg akkoorden kunt editen. Maar Auto-Tune blijkt meer te zijn dan een patent of een stukje software. Het is een begrip. Net zoals Pampers, Kleenex en Pritt is de merknaam een soortnaam geworden.

Puur als pitch-correction-software, zoals het bedoeld is, is Auto-Tune alomtegenwoordig. Elke studio heeft en gebruikt Auto-Tune of de technologie erachter. In 99 procent van wat u op de radio hoort, zit pitch-correction. Maar ook Auto-Tunes extreme versie – het roboteffect – is vandaag overal. De kans is groot dat u niet eens doorhad dat Beyoncé als een robot klinkt in Apeshit omdat u dat niet eens meer registreert. Bazart gebruikt Auto-Tune. Migos gebruikt Auto-Tune. Drake gebruikt Auto-Tune. Stromae gebruikt Auto-Tune. Frank Ocean gebruikt Auto-Tune. Twenty One Pilots gebruikt Auto-Tune. The Weeknd gebruikt Auto-Tune. Iedereen in de pop gebruikt Auto-Tune.

Minder en minder is het een gimmick. Als Katy Perry of Kesha Auto-Tune gebruiken, is dat het doelbewuste geluid van plastic pop. Als Future en zijn generatie rappers het gebruiken, is het het geluid van onthecht-zijn. Als James Blake het gebruikt, is het het geluid van innerlijke leegte in een koude wereld. Als Lil Wayne het gebruikt, is het het geluid van een psychedelische trip op semilegale drugs. Auto-Tune overstijgt zijn technologie en is een soort emotie geworden.

Nu zelfs Jay-Z overstag is gegaan, lijkt ‘Kamp Ja’ het te halen. Auto-Tune heeft de muziek niet geplastificeerd. Het was geen truc om van slechte zangers goede te maken. Het was geen teken van de verloedering van de muziek. Het was gewoon een nieuw stukje technologie zoals de distortionpedaal en de synthesizer dat eerder waren. En wie dat niet kan aanvaarden, heeft allicht gewoon een wat verouderde definitie van wat muziek is.

Als alle grote artiesten die het geluid van de afgelopen decennia hebben bepaald zich aan Auto-Tune hebben gewaagd, mag je het de grootste technologische vernieuwing van de eeuw noemen.

Auto-Tune heeft van Rihanna – Auto-Tune vaart wel bij korrelige stemmen – een nog grotere ster gemaakt. Het heeft mee voor de doorbraak van Daft Punk gezorgd. Het heeft Radiohead geholpen om van koers te veranderen. Het heeft de carrières van Kanye West en Bon Iver nieuwe richtingen uitgeduwd. Het heeft James Blake geholpen om groot worden. Het heeft Future, Travis Scott, Migos en een jonge generatie rappers een eigentijdse sound gegeven. Als alle grote artiesten die het geluid van de afgelopen decennia hebben bepaald zich aan Auto-Tune hebben gewaagd, kun je niet anders dan het de grootste technologische vernieuwing van de eenentwintigste eeuw noemen. En dan zwijgen we nog over de reusachtige impact van Auto-Tune op de Arabische muziek, reggaeton en afrobeat.

Medio jaren vijftig begonnen gitaristen hun versterkers doelbewust te oversturen om een distortioneffect te verkrijgen en had de rock een geluid gevonden dat een gevoel van wilde jeugdigheid uitstraalde. Begin jaren tachtig stond er per ongeluk een microfoon open terwijl Phil Collins aan het drummen was en groeide de ‘gated snare’ – het drumgeluid van In the Air Tonight – uit tot het sonische watermerk van de overdreven pathos van de jaren tachtig. Auto-Tune doet hetzelfde voor de onthechte hiphop en pop van vandaag.

De kans is groot dat Auto-Tune straks weer uit de mode zal raken. Waarschijnlijk zal het, zoals bij alle digitale ontwikkelingen in de muziek, slecht dateren. Maar misschien is dat net goed. Als u over dertig jaar terugkijkt op het nu, zal het geluid dat u daarbij hoort door Auto-Tune gehaald zijn. Het geluid van toekomstige nostalgie. Zoals de gated snare en de synthesizer onlosmakelijk verbonden zijn met de jaren tachtig, is Auto-Tune voor eeuwig verbonden met de jaren 2000 en 2010. Want dat is wat dat roboteffect dat Cher twintig jaar geleden introduceerde is.

Het geluid van de vroege eenentwintigste eeuw.